Verantwoord gebruik van AI is niet alleen een technisch, maar ook ethisch vraagstuk

mei 28, 2025 | 3 minuten leestijd

Verantwoord gebruik van AI in de zorg wordt steeds belangrijker naarmate de rol van kunstmatige intelligentie groter wordt binnen de samenleving. Zo ook in de gezondheidszorg. Tijdens Fe+Male Tech Heroes sprak Vanda, Responsible AI Clinical Lead bij Philips, over het verantwoord gebruik van AI in de gezondheidszorg. Ze kwam met een krachtige boodschap: het gebruik van AI in de zorg biedt een enorme potentie – mits we het op een verantwoorde manier toepassen. En daar heeft iedereen een verantwoordelijkheid in.

De kracht van AI binnen de gezondheidszorg

De manier waarop zorg wordt geleverd binnen ziekenhuizen kan enorm veranderen door de komst van kunstmatige intelligentie. Ook nu al, wordt AI toegepast in oplossingen zoals de Philips MR SmartSpeed en AI Manager, die klinische processen helpen versnellen en zorgprofessionals ondersteunen. AI kan zorgprofessionals tijd besparen op bepaalde taken, zodat zij hun aandacht kunnen richten op de patiënt. “AI is er niet om mensen te vervangen, maar om de fysieke capaciteit van zorgverleners te versterken”, legt Vanda uit. “De echte waarde van AI ontstaat als het helpt mensen te ondersteunen om betere zorg te leveren.”

Leiderschap in verantwoorde AI

AI was een belangrijk thema tijdens de 2025 editie van de Fe+Male Tech Heroes conferentie, welke dit jaar getiteld was “Rethinking Leadership”. “Leiderschap in verantwoord AI is een basisvoorwaarde voor het succes van AI. Alleen als we het goed doen, kan het zijn volledige potentie bereiken,” zegt Vanda. Voor Vanda ligt deze verantwoordelijkheid niet bij één afdeling, maar moet iedereen zich bewust zijn van het belang van verantwoordelijk gebruikt van AI. Ze gaf de deelnemers van haar workshop een kijkje in voorwaarden waaraan verantwoorde AI moet voldoen.

Scherp zijn op gebruikte data

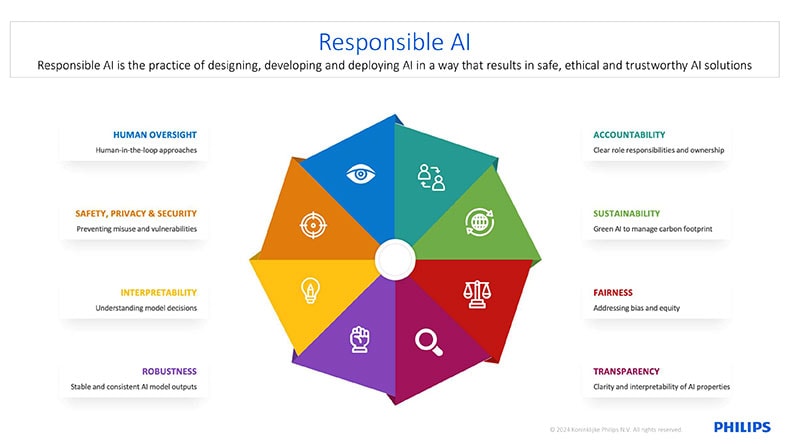

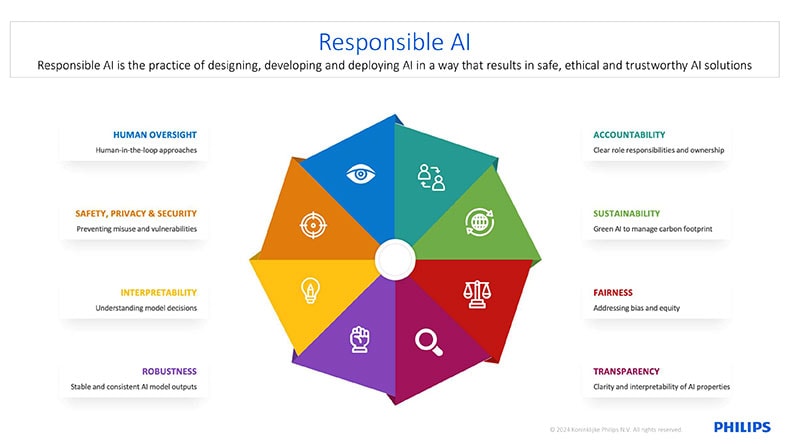

Aan de hand van de Philips Responsible AI Principles, acht in totaal, begeleidde Vanda de deelnemers door het fundament van veilige, ethische en betrouwbare AI-oplossingen: waarbij zaken zoals menselijk overzicht, privacy en security, transparantie, de uitlegbaarheid van het model en eerlijke vertegenwoordiging van doelgroepen verder werden uitgediept. Wanneer AI-modellen input krijgen van beperkte of bevooroordeelde datasets, bepaalde groepen in de samenleving dan niet vertegenwoordigd zijn in de oplossing. Een voorbeeld is het diagnosticeren van hartaanvallen bij vrouwen, wat moeilijker is aangezien de meeste data van hartaanvallen afkomstig is van mannen. “Cruciale keuzes worden dan gemaakt op verkeerde aannames,” aldus Vanda. “En dat is geen technisch, maar een ethisch vraagstuk.”

Iedereen heeft een rol

Met vragen zette Vanda de deelnemers aan het denken: Ben je kritisch op de data die je gebruikt? Is hier toestemming voor gegeven? Wie wordt er wel en niet vertegenwoordigd? Meten we wat we willen meten? Kloppen de conclusies uit dit onderzoek? Op de vraag hoe je als individu kan vertrouwen op de kwaliteit van een onderzoek, artikel of nieuws, is Vanda duidelijk: “Bewustzijn is het belangrijkste startpunt. En vervolgens, check de bronnen.” Ze vervolgt: “Daarom moet bij het gebruik van AI altijd menselijk overzicht zijn. Iedereen kan een rol spelen bij het gebruik van verantwoorde AI”.

De stem van de patiënt

Volgens Vanda is ethische reflectie op AI geen luxe of formaliteit, het is de basis van een veilige en eerlijke technologie. “We moeten AI in de context van de gezondheidszorg plaatsen” zegt ze. “Hier gaat het om patiënten die niet altijd in staat zijn de meest verstandige keuze te maken, en dit vraagt om extra zorgvuldigheid als het gaat om privacy en het gebruik van data. Wij zijn hun stem en daar moeten we verantwoord mee omgaan”.

Philips Future Health Index

Vanda’s workshop valt samen met de wereldwijde publicatie van het Philips Future Health Index rapport. In dit rapport worden zorgprofessionals en patiënten bevraagd over het gebruik van AI in de zorg en de randvoorwaarden voor een effectief gebruik van AI. Het rapport eindigt met een aantal aanbevelingen om het vertrouwen in AI te versterken, waaronder bewezen effectiviteit, het voorkomen van vooroordelen in de data, en de noodzaak voor de juiste wettelijke kaders voor het gebruik van AI. Op 10 juni presenteert Philips het Nederlandse rapport.

Ethics and engineering: the two pillars of AI

Responsible use of AI in healthcare is becoming increasingly important as the role of artificial intelligence grows within society, including in healthcare. During Fe+Male Tech Heroes, Vanda, Responsible AI Clinical Lead at Philips, spoke about the responsible use of AI in healthcare. She delivered a powerful message: the use of AI in healthcare offers immense potential—provided we apply it responsibly. And everyone has responsibility for this.

The Power of AI in Healthcare

Care delivery in hospitals can change significantly with the use of artificial intelligence. Already now, AI is being applied in solutions such as Philips MR SmartSpeed and AI Manager, which help accelerate clinical processes and support healthcare professionals. AI can save time on certain tasks for healthcare professionals, allowing them to focus their attention on the patient. "AI is not there to replace people, but to augment the physical capacity of healthcare providers," Vanda explains. "The real value of AI emerges when it helps support people in delivering better care."

Leadership in Responsible AI

AI was a major theme at the 2025 edition of the Fe+Male Tech Heroes conference, which was titled "Rethinking Leadership." "Leadership in responsible AI is a prerequisite for the success of AI. Only if we do it well can it reach its full potential," says Vanda. For Vanda, this responsibility does not lie with one department alone; everyone must be aware of the importance of responsible AI use. She gave participants in her workshop an insight into the conditions that responsible AI must meet.

Being Critical of Data Used

Using the Philips Responsible AI Principles, a total of eight, Vanda guided participants through the foundation of safe, ethical, and reliable AI solutions, involving aspects such as human oversight, privacy, and security, transparency, explainability of the model, and fair representation of target groups. When AI models receive input from limited or biased datasets, certain groups in society may not be represented in the solution. An example is diagnosing heart attacks in women, which is more difficult because the majority of the data comes from men. "Crucial decisions are then made on incorrect assumptions," according to Vanda. "And that is not a technical, but an ethical issue."

Everyone Has a Role

With questions, Vanda prompted participants to think: Are you critical of the data you use? Is permission given for this? Who is and is not represented? Are we measuring what we want to measure? Are the conclusions from this research correct? The participants are seeking guidance on how they as individuals can trust the quality of research, articles, or news. Vanda: "Awareness is the most important starting point. And then, check the sources." She continues: "Therefore, there must always be human oversight in the use of AI. Everyone can play a role in using responsible AI."

The Patient's Voice

According to Vanda, ethical reflection on AI is not a luxury or formality; it is the foundation of safe and fair technology. "We need to place AI in the context of healthcare," she says. "Here it involves patients who are not always able to make the most sensible choice, and this calls for extra care regarding privacy and data use. We are their voice, and we must deal with it responsibly."

Philips Future Health Index

Vanda’s workshop coincides with the worldwide publication of the Philips Future Health Index report. This report surveys healthcare professionals and patients about the use of AI in healthcare and the prerequisites for effective use of AI. The report concludes with several recommendations to strengthen trust in AI, including proven effectiveness, preventing bias in data, and the need for proper legal frameworks for the use of AI. On June 10th, Philips will present the Dutch report.